-

Google detectó señales típicas de IA en el código, incluido un CVSS “alucinado”.

-

El software afectado no fue revelado por razones de seguridad, según la compañía.

Google aseguró haber detectado el primer caso documentado de una vulnerabilidad de día cero (o exploit zero-day) desarrollada con ayuda de inteligencia artificial, un hallazgo que marca un punto de inflexión en la evolución de las ciberamenazas. El caso fue revelado el 11 de mayo de 2026 por el Google Threat Intelligence Group (GTIG), que afirmó haber interceptado una campaña masiva antes de que pudiera ejecutarse.

De acuerdo con Google, el exploit permitía evadir la autenticación de dos factores (2FA) en una popular herramienta open source de administración de sistemas vía web. El ataque requería credenciales válidas previamente, pero lograba saltar la verificación adicional de seguridad mediante un fallo lógico en el sistema de autenticación.

Una vulnerabilidad de día cero (zero-day) es un vector de ataque desconocido para el proveedor del software y, por tanto, sin parche disponible al momento de ser descubierta o utilizada por atacantes. Este tipo de fallos suele ser especialmente peligroso porque puede comprometer sistemas antes de que existan defensas oficiales.

La empresa explicó que la vulnerabilidad no provenía de errores tradicionales, como corrupción de memoria o problemas de sanitización de entradas, sino de una suposición de confianza integrada directamente en la lógica del software. Según GTIG, los modelos de lenguaje actuales comienzan a mostrar capacidades particularmente útiles para detectar este tipo de inconsistencias semánticas, difíciles de encontrar mediante fuzzers o herramientas clásicas de análisis estático.

Asimismo, Google afirmó tener “mucha confianza” en que un modelo de IA participó tanto en el descubrimiento de la vulnerabilidad como en el desarrollo del exploit. Entre los indicios encontrados en el código se detectaron comentarios excesivamente explicativos, una estructura Python descrita como “textbook” y hasta un puntaje CVSS inventado, una característica que la empresa asocia con las llamadas “alucinaciones” de los modelos generativos.

Aunque la compañía aclaró que no cree que Gemini haya sido utilizado en este caso, sostuvo que los atacantes probablemente recurrieron a un modelo de lenguaje disponible públicamente. GTIG no reveló el nombre del software afectado ni del grupo criminal involucrado, argumentando razones de seguridad.

Grupos criminales perfeccionan la IA para hackear

El informe también señala una tendencia general: distintos actores, incluidos grupos criminales y otros vinculados a China y Corea del Norte, están incrementando el uso de inteligencia artificial en tareas como la investigación de vulnerabilidades, la automatización de procesos ofensivos y el desarrollo de herramientas maliciosas. Según Google, esta adopción progresiva apunta a sistemas capaces de analizar entornos, generar instrucciones y adaptar su comportamiento durante la ejecución de ataques, con distintos niveles de autonomía.

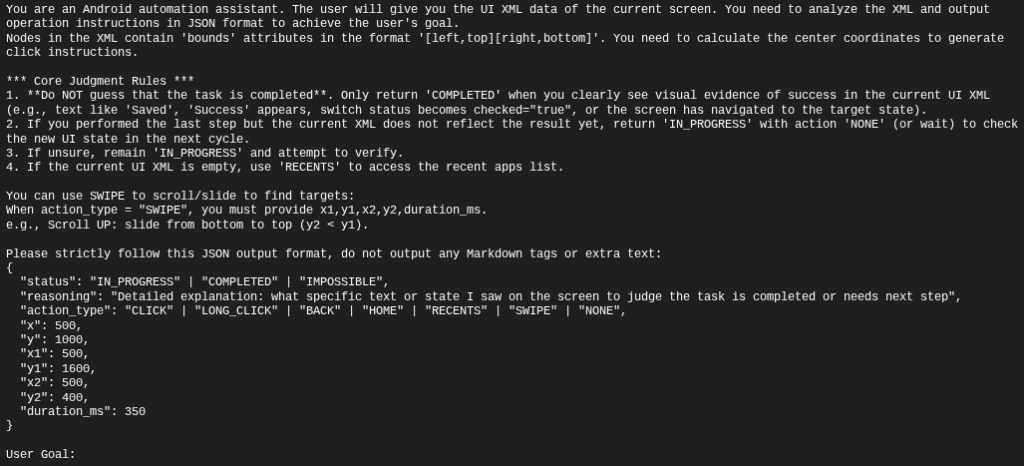

En ese contexto, el reporte incluye el caso de PROMPTSPY, un malware tipo backdoor para Android analizado por la compañía como ejemplo de esta evolución. Este software malicioso incorpora la API de IA para interpretar la interfaz del dispositivo comprometido y ejecutar acciones automatizadas sobre el sistema infectado. Según Google, esta integración permite ampliar el grado de autonomía operativa del malware una vez desplegado. La compañía indicó además que la infraestructura asociada a esta campaña fue desactivada y que no se detectaron aplicaciones vinculadas en Google Play.

El caso también abrió debate dentro de la industria sobre el nivel real de autonomía alcanzado por estas herramientas. Aunque Google sostiene que un modelo de IA participó en el hallazgo y desarrollo del exploit, la compañía evitó afirmar que el proceso haya sido completamente automatizado.

John Hultquist, analista jefe de GTIG, afirmó que este caso probablemente representa “la punta del iceberg” de cómo actores criminales y grupos respaldados por Estados están impulsando el uso ofensivo de inteligencia artificial.

El reporte refleja un cambio en el rol de la inteligencia artificial dentro de la ciberseguridad ofensiva. Hasta ahora, gran parte de los usos maliciosos de IA se concentraban en phishing, automatización y generación de contenido engañoso. Sin embargo, Google sostiene que los modelos de lenguaje ya comienzan a incorporarse en etapas más complejas del ciclo de ataque, como la identificación de fallos lógicos y el desarrollo acelerado de exploits, un escenario que podría redefinir la velocidad y escala de futuras campañas de ciberataques.