-

Para algunos este es el primer hackeo documentado a un código generado por IA.

-

Expertos señalan que el equipo humano falló al supervisar las líneas de código generadas por IA.

El protocolo de finanzas descentralizadas Moonwell registró una pérdida de 1,7 millones de dólares el pasado 15 de febrero. Un error crítico en un contrato inteligente causó que los hackers aprovecharan una vulnerabilidad que involucró la configuración de precios del activo cbETH dentro de la red Base. Este incidente destaca por la participación directa de una inteligencia artificial en la creación del código vulnerable.

El error ocurrió cuando el sistema registró el precio de cbETH en apenas 1,12 dólares, pese a que el valor real del activo en el mercado superaba los 2.200 dólares. Esta diferencia abismal permitió que usuarios malintencionados explotaran la valoración incorrecta de las garantías. El equipo de Moonwell confirmó el monto del daño financiero poco después de detectar la anomalía en sus oráculos.

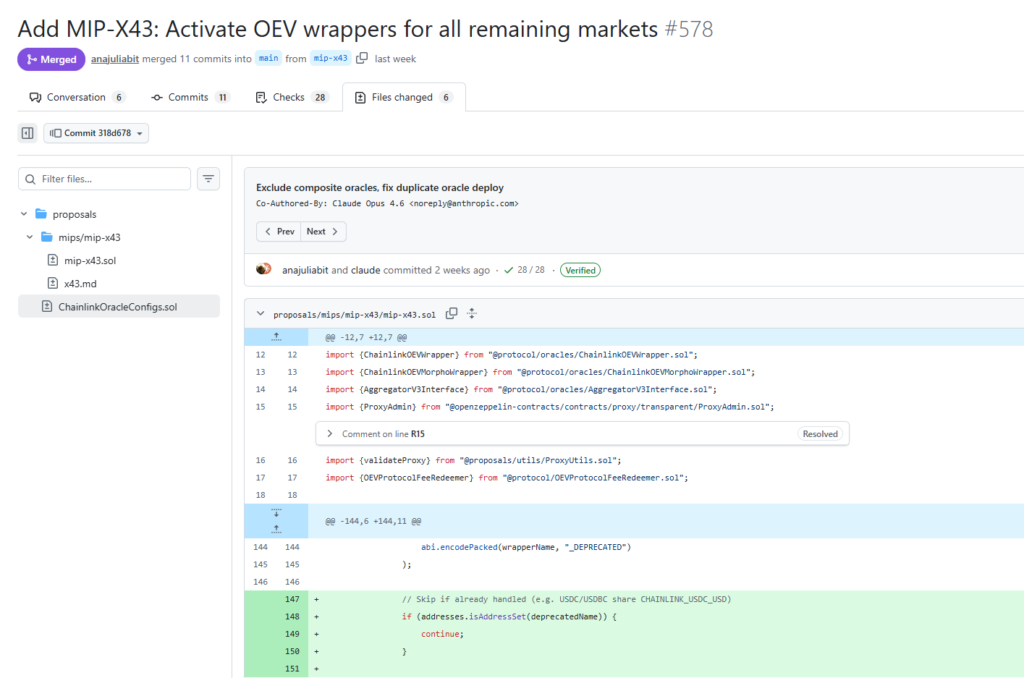

La comunidad técnica identificó al responsable del código defectuoso en el repositorio oficial de GitHub. El registro del «Pull Request» #578 mostraba una etiqueta inusual de coautoría. El texto acreditaba explícitamente a «Claude Opus 4.6», un modelo de inteligencia artificial de la empresa Anthropic. Esta es la primera vez que un error de este tipo se vincula directamente a un asistente de IA.

Un Pull Request es un proceso donde los programadores proponen cambios al código principal de un proyecto. En esta etapa, otros desarrolladores deben revisar y aprobar las modificaciones antes de su implementación definitiva. El error técnico del contrato Moonwell pasó todas las revisiones humanas a pesar de su gravedad. De manera que los revisores no detectaron la configuración errónea que la inteligencia artificial sugirió originalmente.

En el portal donde Moonwell publicó el resumen del incidente, diversos usuarios informaron que sus préstamos de USDC respaldados por cbETH fueron liquidados tras fijarse el precio sobre los 1,12 USD. Los afectados califican lo sucedido como un ‘robo’ y exigen un plan de compensación por parte de la plataforma.

El auge peligroso del «vibecoding»

Este suceso alimenta el debate sobre la tendencia actual denominada vibecoding. Este término describe la práctica de programar basándose en instrucciones de lenguaje natural procesadas por IA. Muchos desarrolladores priorizan la velocidad de entrega sobre la comprensión profunda de la lógica del software. La confianza ciega en las sugerencias de modelos generativos aumenta los riesgos en entornos financieros críticos.

Diversos especialistas denuncian que las grandes empresas tecnológicas impulsan esta práctica para reducir costes operativos. Sin embargo, la inteligencia artificial carece de contexto sobre el impacto económico de una cifra mal colocada. La responsabilidad final recae siempre en los humanos que validan el trabajo de la máquina. El caso de Moonwell demuestra que las herramientas de IA requieren una supervisión técnica mucho más rigurosa y escéptica.